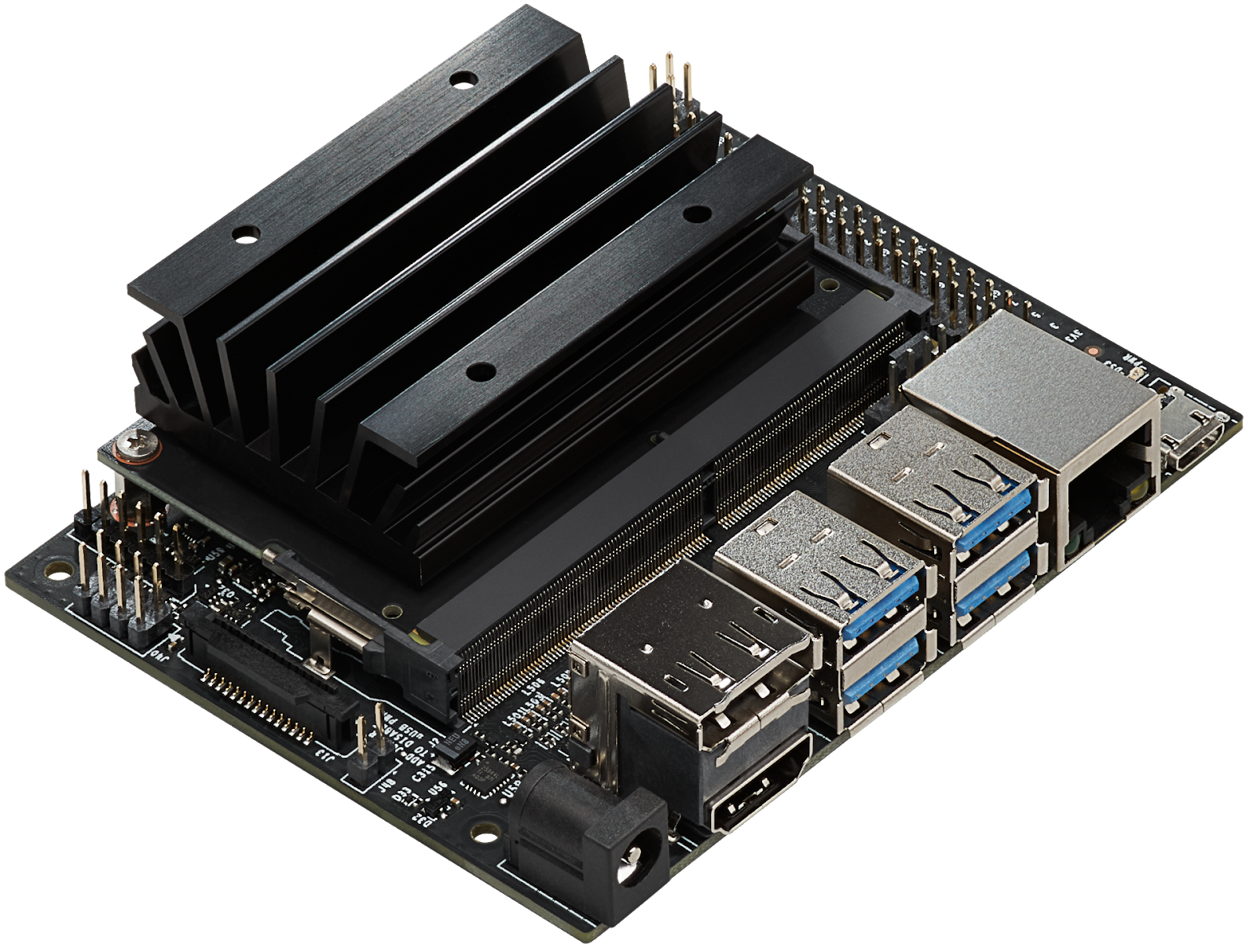

detectnet 可以直接打开rtsp网络摄像头作为输入源,进行实时视频分析,在监控领域有非常大的应用。

尝试了下打开rtmp流,没有成功,返回说不支持。

从日志输出来看是使用GStreamer。

[gstreamer] gstDecoder -- unsupported protocol (rtmp)

[gstreamer] supported protocols are:

[gstreamer] * file://

[gstreamer] * rtp://

[gstreamer] * rtsp://

[gstreamer] gstDecoder -- failed to build pipeline string

[gstreamer] gstDecoder -- failed to create decoder for rtmp://192.168.0.2/live/bbb

detectnet: failed to create input stream

如果是GStreamer,那当然应该支持rtmp才对。打开并修改源码

jetson-inference/utils/codec/gstDecoder.cpp

原创文章,转载请注明: 转载自贝壳博客

本文链接地址: Jetson 把玩记 三、rtmp直播流物体识别定位